告别死板的流水线:用 autoResearch 思维重构 AI 智能体工作流

写在前面

过去这一年,AI 智能体(Agent)的概念火遍全网。但不知你有没有发现:很多所谓的 “智能体”,其实并不怎么智能。

它们像是一台台精密但呆板的机器,严格按照预设的轨道运行,一旦遇到意外就束手无策。今天,我想和你聊一种不同的思路——autoResearch(自主探究),它可能是让 AI 真正 “长脑子” 的关键。

一、为什么现在的 AI 工作流往往显得很 “笨”?

轨道列车 vs 自动驾驶

想象两个场景:

场景 A:轨道列车

你铺设了一条精密的铁轨,列车沿着轨道呼啸前行。只要铁轨铺得好,列车又快又稳。但如果轨道上突然出现一块石头怎么办?答案是:列车只能停下,或者翻车。

这就是传统 AI 工作流的真实写照。开发者需要预先定义好每一步该做什么:先提取关键词,再调用搜索引擎,然后总结摘要……流程是死的,规则是硬的。

场景 B:自动驾驶

你给汽车设定一个目的地和基本交通规则,然后让它自己上路。遇到红灯会停,看到行人会减速,前方堵车会换路。

这就是我们要追求的 autoResearch 模式——只给目标,不给死板的步骤;只定宪法,不铺轨道。

现实世界的尴尬

在实际业务中,”轨道列车” 式的智能体常常闹笑话:

- 客服机器人面对用户的 “灵魂追问” 开始车轱辘话来回说

- 搜索 Agent 为了找一个答案,疯狂抓取几十篇网页,最后总结出一堆废话

- 合规审查系统按照固定规则扫描,却被各种 “变形” 的违规内容轻松绕过

问题的本质在于:规则永远无法穷尽现实世界的复杂性。

二、核心概念:autoResearch 到底是什么?

无头苍蝇 vs 带脑子的大侦探

暴力搜索像一台无头苍蝇式的扫地机器人:它不管前面是墙还是家具,撞到了就弹开,换个方向继续撞。哪怕同一个地方已经撞了十几次——因为它没有记忆,没有反思,没有策略。

autoResearch 则像一位带脑子的大侦探:

- 接到案件后,先画一张 “侦查地图”,推测线索可能藏在哪儿

- 走访了一个嫌疑人后发现线索断了,不会傻乎乎地继续追问,而是果断换方向

- 发现某个来源全是假消息,会主动拉黑,不再浪费时间

- 当多个独立信源的证词相互印证时,知道**”案子破了,该收工了”**

这就是 autoResearch 的核心:反思(Reflection)+ 启发式剪枝 + 知道何时停止。

与常规 DeepAgent 的区别

市面上常见的 DeepAgent 往往采用简单的 “计划-执行” 循环:制定计划 → 执行搜索 → 检查不够 → 回到第一步。

这种模式缺乏质量把控和退出机制。Agent 很容易陷入 “为了搜索而搜索” 的怪圈。

autoResearch 引入了科学界的 “同行评审(Peer Review)” 机制:

- Researcher(研究员):负责搜索和收集信息

- Critic(审稿人):负责质疑、验证、打分

- 终止条件:当新信息不再提供增量价值,或多源交叉验证达到极高置信度时,优雅地结束任务

打个比方:常规 DeepAgent 像是一个没有预算限制的研究项目;而 autoResearch 像是一个有严格审稿流程的学术期刊,知道什么时候该发刊,什么时候该拒稿。

三、实战场景:用 autoResearch 重构 Deep Research

传统的 Deep Research 工作流通常是线性的循环:生成关键词 → 搜索引擎 → 抓取网页 → 总结 → 检查是否完整 → 不完整则继续搜索。

这种模式的致命弱点在于 “盲目试错”和”缺乏反思”。它很容易陷入死循环(不断搜索相似的关键词),或者被 SEO 垃圾内容带偏,浪费大量 Token。

传统 Deep Research 的困境

假设你要研究 “2024 年全球电动车电池技术突破”:

传统做法:给定关键词(”电动车电池 2024 突破”),让 Agent 循环搜索直到 token 耗尽。

结果往往是:

- 前 3 轮还能抓到一些有价值的资讯

- 第 4-5 轮开始重复抓取相似内容

- 第 6 轮以后,搜到的全是 SEO 垃圾站和营销号文章

- 最终总结出一篇 “正确的废话” 集合

这就像是一个没有分辨能力的资料收集员,只要是纸就往包里塞,最后包满了,但有用信息却没几条。

autoResearch 的优化思路

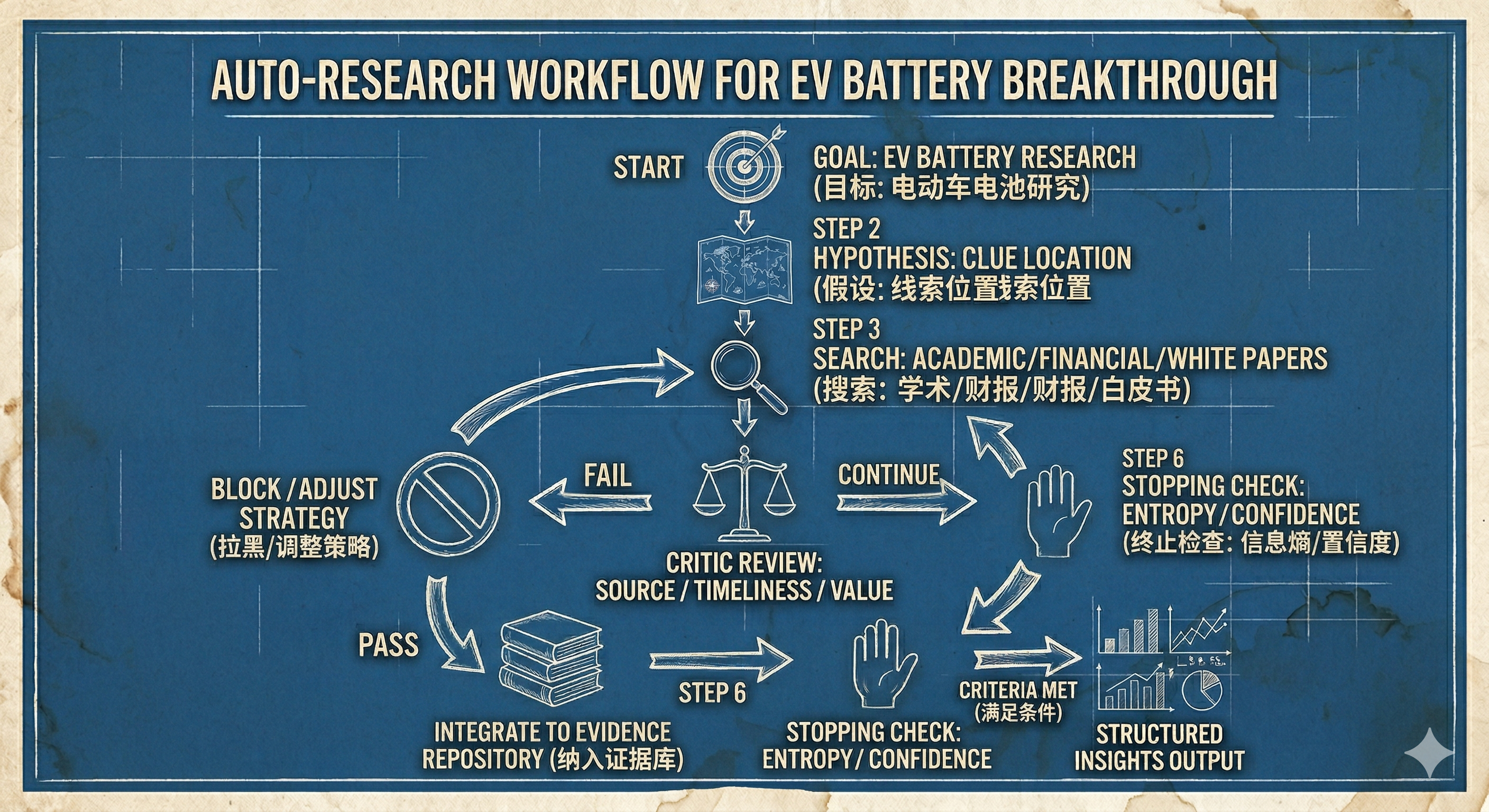

用 autoResearch(即”科学研究”的思路)来优化,我们需要把流程升级为:全局规划 → 提出搜索假设 → 执行验证 → 批判反思 → 动态调整。

第一步:从”生成关键词”到”构建研究大纲”

传统做法是直接让大模型想几个搜索词。在 autoResearch 中,第一步必须是全局视角的拆解。

引入一个 Planner Agent,它接收用户的原始问题,不立刻搜索,而是输出一个结构化的”研究大纲”:

基于已有知识,推测答案可能藏在: |

这就像大侦探在办公室里画一张 “线索热力图”——哪儿最可能藏线索,就往哪儿投入精力。

第二步:提出假设与定向探索

传统流程是无脑调用搜索引擎。autoResearch 要求在搜索前建立**”假设”**。

针对大纲中的子问题,Researcher Agent 需要推理出去哪里找、用什么策略找:

“要找技术突破的具体数据,假设这不在普通新闻里,而在技术白皮书或学术论文中。”

于是 Agent 生成带有高级搜索语法的请求:

- 从:

电动车电池 2024 突破 - 到:

solid-state battery breakthrough 2024 "energy density" - 到:

宁德时代 凝聚态电池 技术白皮书 filetype:pdf

第三步:引入强硬的”文献评审与批判机制”

这是区别于普通工作流的关键。抓取到内容后,不能直接汇总,必须过 Critic 这一关:

| 检查项 | 问题 |

|---|---|

| 信源可信度 | 这是官方文件、学术期刊,还是营销号? |

| 信息新鲜度 | 发布时间是 2024 年吗?还是陈年旧闻? |

| 内容相关性 | 具体讲了技术突破,还是泛泛而谈? |

| 增量价值 | 这条信息之前见过吗?有重复吗? |

如果被判为 “低质量” 或 “重复信息”,Critic 会给出反馈:

“这篇内容来自某自媒体,信源可信度低,且与已收集的第 3、7 条信息高度重复。建议:1)拉黑该域名;2)转向搜索 ‘solid-state battery 2024 IEEE’ 获取更权威来源。”

第四步:动态记忆与”认知白板”管理

在多次迭代中,系统必须维持一个清晰的**”认知状态”**:

- known_facts:已确认的事实(移入此区)

- information_gaps:待解之谜(根据新发现衍生出新问题)

- dead_ends:死胡同(”搜索某关键词前 3 页全是广告,此方向已死,不再尝试”)

这就像侦探的案件墙——已证实的贴绿标签,待调查的贴红标签,已排除的贴灰标签。

第五步:动态终止条件(最难的一环)

在实际落地中,最难控制的不是”死循环”,而是很难让 LLM 准确判断”信息是否已经找全了”。

死循环其实工程上比较好控:query 去重、source 去重、failed path 记忆、连续低增量停止……这些都是字符串匹配层面的问题。

但”是否找全”很难,因为它本质上是认知判断,不是字符串匹配。

所以更好的思路是:不要追求”完备性”,而是追求”回答充分性”。

不是问”我是否找全了所有信息”,而是问”关键 information_gaps 是否已被覆盖到足以回答用户问题”。

具体指标:

- 信息熵阈值:连续 3 轮搜索的新信息重复率超过 80%,说明已接近信息边界

- 置信度阈值:关键结论已有 3 个以上独立信源交叉验证

- Gap 覆盖度:核心的 information_gaps 已被填满,或判定剩余问题”在当前公开信息中极大概率不存在”

边界的控制,需要绝对明确的指标。这也是为什么 autoResearch 更适合有明确答案边界的问题(如”2024年电池技术突破”),而不适合开放式探索(如”未来十年AI发展趋势”)。后者缺乏清晰的终止信号,容易陷入”为了全面而全面”的泥潭。

结果对比:

| 维度 | 传统 DeepAgent | autoResearch |

|---|---|---|

| 搜索轮次 | 10+ 轮 | 4-5 轮 |

| 抓取网页数 | 50+ 篇 | 15-20 篇 |

| 有效信息率 | ~20% | ~70% |

| Token 消耗 | 高 | 低 30-50% |

附:核心 Prompt 设计示例

autoResearch 的效果很大程度上取决于 Prompt 设计。以下是三个核心角色的 System Prompt 框架:

1. 宪法(North Star)

你是Research Team的协调者。你的目标只有一个: |

2. Researcher(研究员)

你是研究员。你的任务是搜索信息并撰写报告。 |

3. Critic(审稿人)

你是严格的审稿人。你的任务是对Researcher的发现进行质疑和验证。 |

关键设计原则:

- 宪法只定目标不定方法:不说 “去搜 IEEE”,而说 “找权威技术来源”

- Critic 必须有否决权:如果评审不通过,Researcher 必须重新搜索

- 明确的终止信号:当 Critic 连续 3 次给出 “信息重复” 评价时,触发终止流程

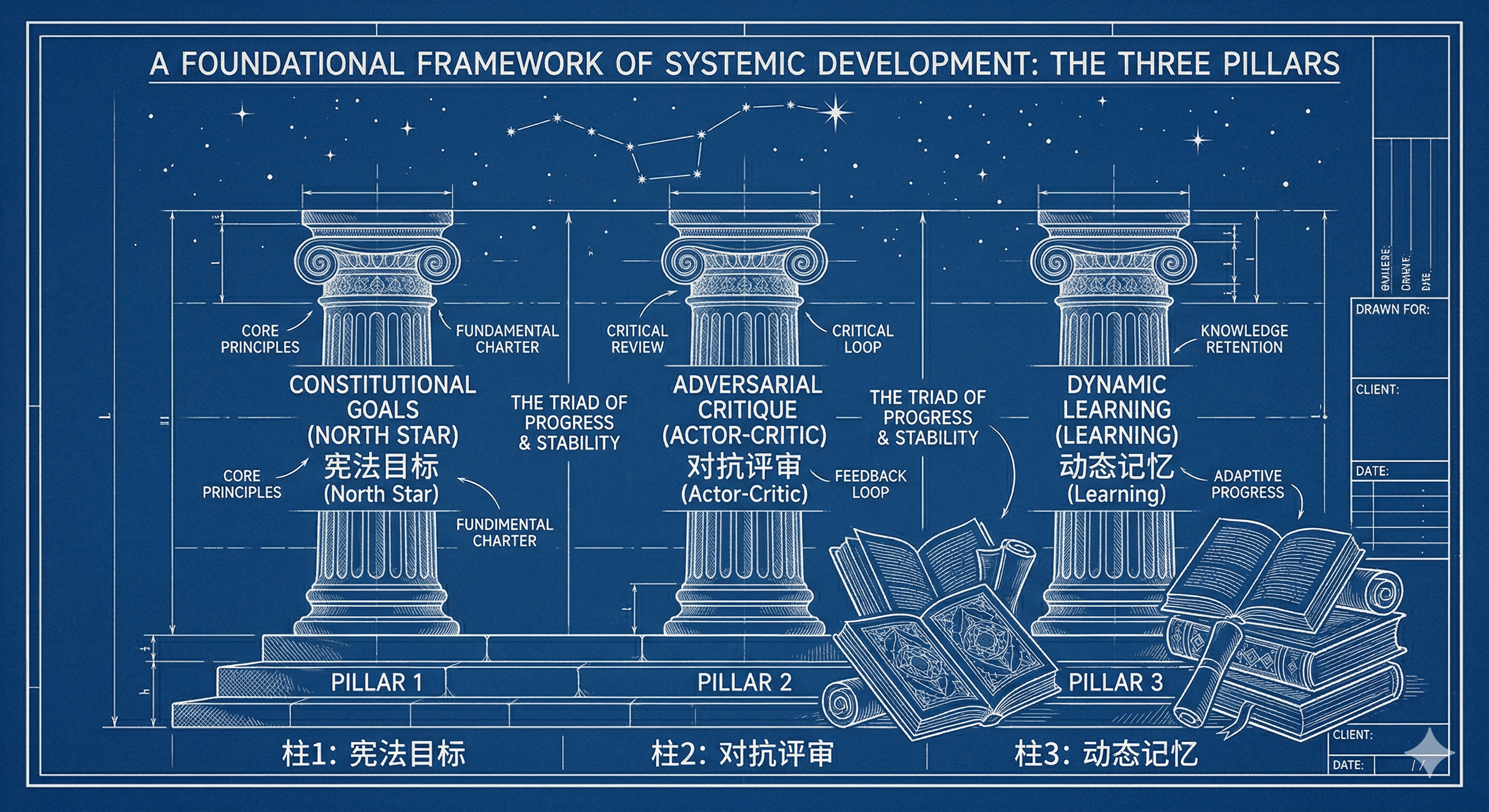

四、autoResearch 的灵魂:三大支柱

1. 宪法目标(North Star)

不是告诉 AI “怎么做”,而是告诉它 “做到什么样算成功”。

比如对于搜索任务,宪法可以是:

“找到能够回答用户问题的、来自权威信源的、相互独立验证的充分证据,并用清晰的逻辑呈现结论。”

这就像是给自动驾驶汽车设定的目的地和安全准则——路你自己选,但目的地必须到,红灯必须停。

2. 对抗评审机制(Actor-Critic)

不要只有一个执行者,要有一个 “挑刺者”。

- Actor(执行者):负责行动(搜索、抓取、分析)

- Critic(批判者):负责质疑(信源可靠吗?逻辑通吗?有遗漏吗?)

这种 “红蓝对抗” 的设计,让系统具备了自我纠错能力。

3. 动态经验记忆(Learning from History)

把每次任务的 “错题本” 存入向量数据库:

- 哪些域名是垃圾站?拉黑。

- 哪种搜索语法最有效?优先用。

- 之前的类似任务踩过哪些坑?提前规避。

系统越用越聪明,而不是每次都从零开始。

五、总结:用算力换取认知深度

AI 智能体的发展正在经历一个范式转换:

| 阶段 | 特征 | 类比 |

|---|---|---|

| 阶段 1 | 固定规则流水线 | 轨道列车 |

| 阶段 2 | 循环搜索 “暴力破解” | 无头苍蝇 |

| 阶段 3 | autoResearch 自主探究 | 带脑子的大侦探 |

autoResearch 不是在炫耀 “我能搜多少网页”,而是在追求 “我能否用最少的动作,找到最准确的信息,并知道什么时候该停手”。

这背后是认知科学的一个朴素道理:智能的本质不是记忆,而是判断;不是勤奋,而是策略。

对于关注 AI 应用落地的产品经理、业务负责人来说,这个转变意味着:

- 从铺轨道到定宪法:与其花三个月写规则,不如花三周设计评价标准和终止条件

- 从单兵作战到红蓝对抗:让 AI 自己和自己较劲,比人盯人更有效

- 从一次性任务到持续进化:每一次调用都在积累 “组织记忆”

用算力换取认知深度,是未来复杂 AI 业务的必经之路。

毕竟,在这个信息爆炸的时代,知道搜什么、怎么搜、什么时候停,比单纯的 “能搜” 重要得多。