Agent Teams:从"单兵作战"到"团队协作"的AI编程革命

引言:当AI不再单打独斗

想象这样一个场景:你需要开发一个完整的电商系统,包括用户认证、商品管理、订单系统、支付接口和后台管理。如果只有一个AI助手,它需要在不同的上下文之间来回切换——刚设计完数据库表结构,又要去写前端页面,还要记得之前的所有细节。这就像让一个人同时担任产品经理、架构师、前端工程师、后端工程师和测试工程师。

这种单Agent模式在面对复杂任务时,会遇到三个致命问题:

- 上下文爆炸:任务越复杂,需要记住的信息越多,很快会超出模型的上下文窗口限制

- 能力稀释:一个Agent试图包揽所有事情,结果每件事都做不到最好

- 串行瓶颈:所有任务必须排队等待,效率低下

Agent Teams(智能体团队)正是为了解决这些问题而诞生的。它不是让AI变得更”聪明”,而是让AI像人类团队一样分工协作。

核心概念:什么是Agent Teams

Agent Teams是一种将多个AI Agent组织起来协同工作的架构模式。它的核心思想很简单:专业的事交给专业的”人”去做。

与单Agent的本质区别

| 维度 | 单Agent | Agent Teams |

|---|---|---|

| 工作模式 | 一个人包揽所有 | 团队协作,各司其职 |

| 上下文管理 | 所有信息塞进一个窗口 | 每个Agent只关注自己的子任务 |

| 处理能力 | 受限于单一模型的能力边界 | 通过组合实现1+1>2 |

| 关键角色 | 无 | Orchestrator(协调者) |

最重要的区别确实是那个”监工”——Orchestrator(协调者/编排器)。

但Orchestrator不只是简单的任务分发,它承担着三个核心职责:

- 任务拆解:将复杂需求拆成可独立执行的子任务

- 资源调度:决定哪个Agent做什么,何时做,能否并行

- 结果整合:将多个Agent的输出融合成统一的结果

没有这个”监工”,Agent Teams就只是多个各自为战的Agent,无法形成协作。

实际案例:我是如何用Agent Teams重构项目的

让我用一个真实的案例来说明Agent Teams的工作方式。

场景:重构一个遗留的Node.js项目

项目背景:

- 5万行代码的Express后端

- 混合了Callback和Promise

- 没有TypeScript

- 测试覆盖率不到20%

- 我需要在一周内完成现代化改造

如果我用单Agent模式,大概会这样:

我:帮我重构这个项目 |

而使用Agent Teams,我的工作流是这样的:

Step 1: 创建侦察小队

# 创建团队 |

效果:4个Agent并行工作,10分钟后我拿到了4份完整的分析报告。如果用一个Agent串行执行,至少需要40分钟。

Step 2: 架构设计

基于侦察报告,Orchestrator(也就是我作为主Agent)决定:

# 让架构设计Agent设计TypeScript迁移方案 |

Step 3: 分模块重构

有了方案后,再次并行执行:

# 3个独立的重构任务,各自负责不同模块 |

对比结果

| 指标 | 单Agent模式 | Agent Teams |

|---|---|---|

| 分析阶段耗时 | ~40分钟 | ~10分钟 |

| 是否遗漏关键信息 | 容易遗漏 | 4份报告互相验证 |

| 重构质量 | 上下文丢失,容易出错 | 每个模块专注处理 |

| 总耗时 | 预计3-4天 | 实际2天完成 |

深入理解:Agent Teams的协作模式

理解了基本概念后,我们来看看业界有哪些成熟的协作模式。

模式一:Orchestrator模式(项目经理型)

这是Claude Code和RooCode中最常见的模式。

核心思想:一个中心化的Orchestrator负责任务拆解和结果整合,Sub-agents只负责执行。

用户请求 |

适用场景:任务可以清晰拆解,子任务之间依赖较少。

RooCode的实现方式:

在.claude/agents/目录下预定义角色:

.claude/agents/ |

每个角色文件定义了:

- 角色定位:我是谁,我擅长什么

- 能力边界:我能做什么,不能做什么

- 工具权限:只读?可编辑?可执行?

模式二:对话协作模式(AutoGen)

Microsoft的AutoGen采用了一种更松散的协作方式:Agent之间可以直接对话,不需要通过中心节点。

Agent A ←→ Agent B ←→ Agent C |

特点:

- Agent可以主动发起对话请求信息

- 支持Human-in-the-loop(人类可随时介入)

- 适合探索性任务,流程不固定

伪代码示例:

# 定义不同角色的Agent |

模式三:流水线模式(LangGraph)

LangGraph将Agent协作建模为状态机,适合有明确流程的任务。

[开始] → [需求分析] → [架构设计] → [代码实现] → [代码审查] → [测试] → [结束] |

特点:

- 每个节点是一个Agent或工具

- 边定义流转条件

- 支持循环(如审查不通过返回修改)

模式四:SOP模式(MetaGPT)

MetaGPT引入了标准操作流程的概念,模拟软件公司的组织方式。

| 角色 | 输入 | 输出 | SOP |

|---|---|---|---|

| 产品经理 | 用户需求 | PRD文档 | 需求分析→功能列表→优先级排序 |

| 架构师 | PRD | 技术设计文档 | 选型→架构图→API设计 |

| 项目经理 | 技术设计 | 任务列表 | 拆解→估时→依赖分析 |

| 工程师 | 任务 | 代码 | 实现→自测→文档 |

| 测试工程师 | 代码 | 测试报告 | 用例设计→执行→Bug报告 |

关键创新:每个角色都有标准化的输入输出格式,确保信息传递不丢失。

主流框架对比

| 框架 | 协调模式 | 适用场景 | 学习曲线 | 生态成熟度 |

|---|---|---|---|---|

| Claude Code | Orchestrator | IDE集成开发 | ⭐ 低 | ⭐⭐⭐⭐⭐ |

| RooCode | 预定义角色 | 定制化开发 | ⭐⭐ 中 | ⭐⭐⭐⭐ |

| AutoGen | 对话驱动 | 研究/实验 | ⭐⭐ 中 | ⭐⭐⭐⭐⭐ |

| LangGraph | 状态机 | 复杂工作流 | ⭐⭐⭐ 高 | ⭐⭐⭐⭐ |

| CrewAI | 角色委派 | 业务流程 | ⭐⭐ 中 | ⭐⭐⭐ |

| MetaGPT | SOP流程 | 完整软件项目 | ⭐⭐ 中 | ⭐⭐⭐ |

学术研究支撑

Agent Teams并非凭空出现,它建立在多智能体系统(Multi-Agent Systems, MAS)几十年的研究基础之上。

里程碑论文

| 论文 | 作者 | 核心贡献 |

|---|---|---|

| AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation (2023) | Microsoft Research | 提出对话驱动的多Agent框架,支持代码执行和人机协作 |

| MetaGPT: Meta Programming for Multi-Agent Collaborative Framework (2023) | 深兰科技、中科院等 | 引入SOP概念,将软件开发流程标准化,HumanEval达到85.9% |

| ChatDev: Communicative Agents for Software Development (2023) | 清华大学、OpenBMB | 模拟软件公司组织,通过自然语言通信实现端到端开发 |

| CrewAI Multi-Agent Framework (2024) | João Moura | 面向生产的角色扮演框架,强调任务委派和工具集成 |

| A Survey on Large Language Model based Autonomous Agents (2024) | 多机构 | 系统性综述LLM-based Agent的最新进展,包括多Agent协作 |

关键研究问题

学术界在Multi-Agent领域关注的核心问题:

任务分配(Task Allocation)

- 如何将任务分配给最合适的Agent?

- 如何平衡负载?

通信协议(Communication Protocols)

- Agent之间应该传递什么信息?

- 如何减少通信开销?

共识机制(Consensus Mechanisms)

- 当多个Agent意见不一致时,如何决策?

- 如何避免”一言堂”或”各执一词”?

涌现行为(Emergent Behavior)

- 多个简单Agent协作能否产生复杂智能?

- 如何引导涌现行为向期望方向发展?

最佳实践:如何用好Agent Teams

1. 任务拆解的黄金法则

DO(推荐):

- ✅ 子任务之间相互独立,可以并行

- ✅ 每个子任务有明确的输入和输出定义

- ✅ 粒度适中(一个子任务约10-30分钟完成)

DON’T(避免):

- ❌ 子任务之间频繁依赖,需要大量来回通信

- ❌ 拆解过细(协调开销 > 执行收益)

- ❌ 拆解过粗(失去并行优势)

2. 通信设计原则

❌ 反模式:频繁来回询问 |

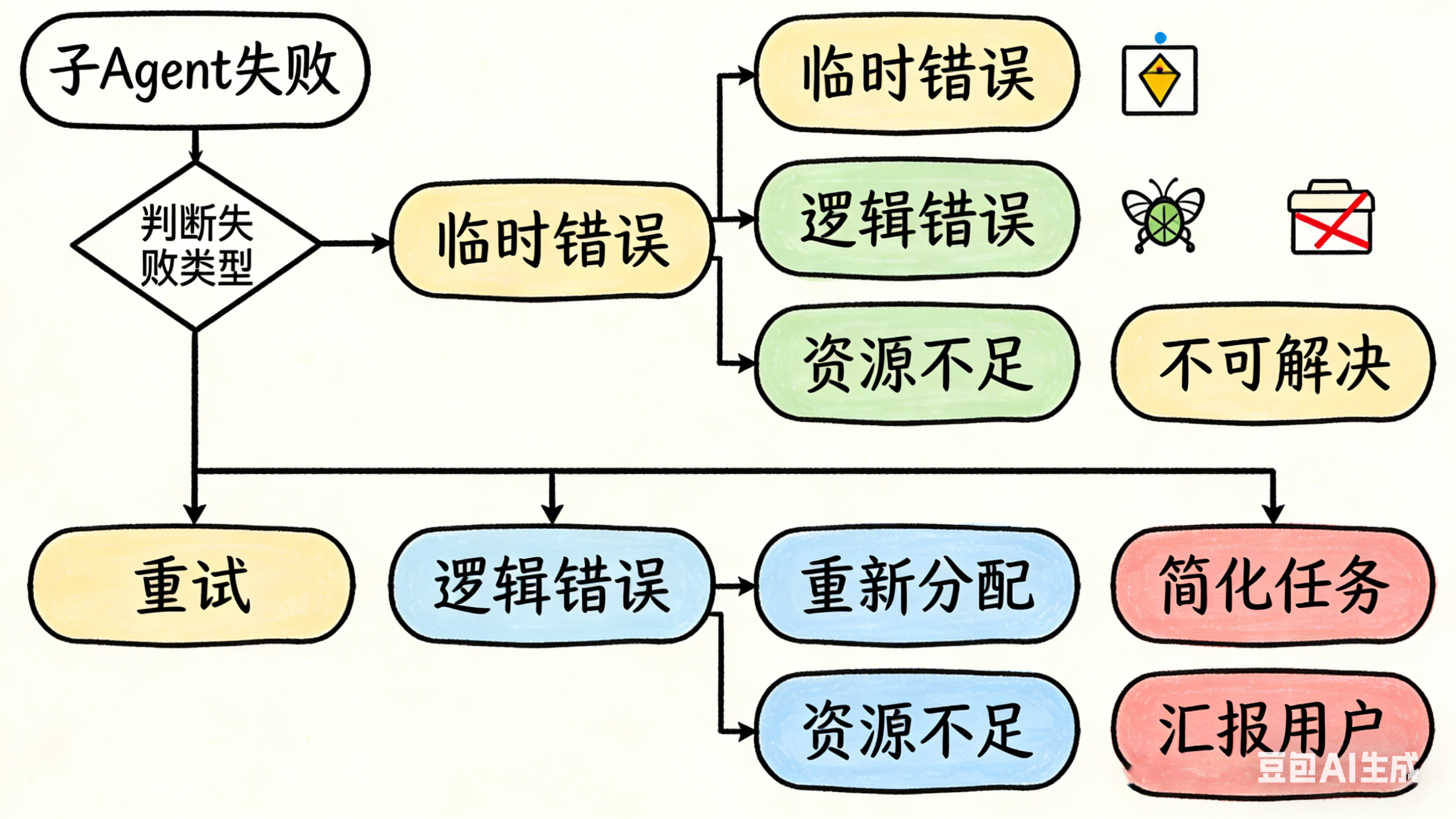

3. 错误处理策略

子Agent执行失败 |

4. 权限管理

给Agent设置合适的权限边界:

| Agent类型 | 建议权限 | 原因 |

|---|---|---|

| 代码探索类 | 只读 | 防止意外修改 |

| 架构设计类 | 只读 | 只输出设计方案 |

| 代码实现类 | 可编辑 | 需要写代码 |

| 代码审查类 | 只读 | 保持客观性 |

| 测试类 | 可编辑测试文件 | 只修改测试代码 |

常见误区

误区一:Agent越多越好

事实:Agent数量增加会带来协调开销。研究表明,当Agent数量超过7个时,协调成本会指数级上升。

建议:一般项目3-5个Agent最合适。

误区二:Agent Teams能解决一切问题

事实:对于简单、线性的任务,单Agent反而更高效。

适用Agent Teams的信号:

- 任务可以自然分解为多个独立子任务

- 需要不同领域的专业知识

- 有并行处理的空间

- 单Agent的上下文已不够用

误区三:Orchestrator只是传话筒

事实:好的Orchestrator是”项目经理+架构师+QA”的综合体。它需要:

- 理解业务需求

- 合理拆解任务

- 判断子Agent输出质量

- 整合时有取舍和决策

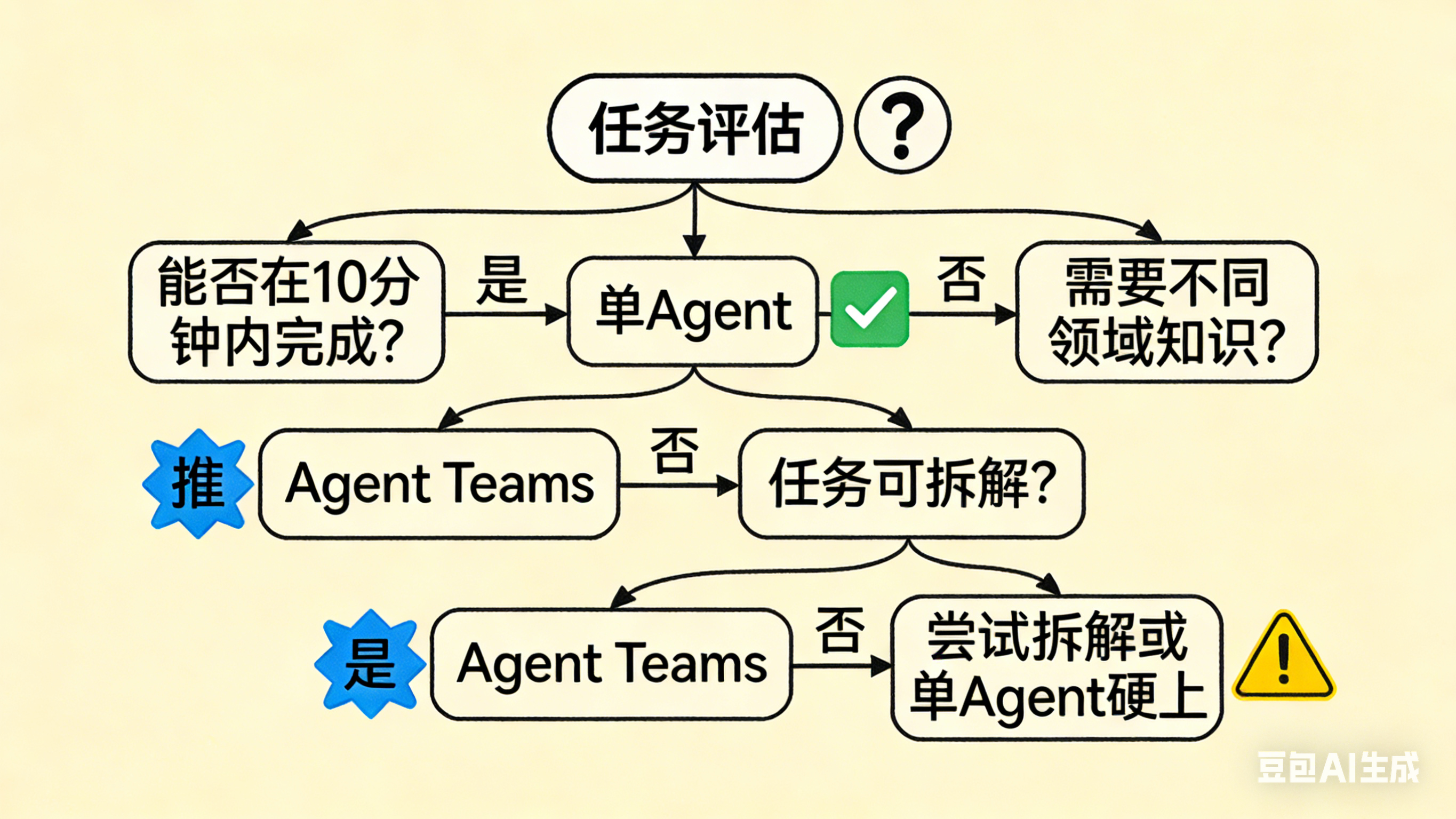

总结:什么时候需要Agent Teams

Agent Teams不是银弹,但它确实解决了单Agent无法处理的复杂问题。

使用决策树

任务评估 |

核心要点回顾

- 本质区别:Agent Teams与单Agent的最大区别是存在Orchestrator进行协调

- 核心优势:通过分工协作解决复杂问题,而非让一个Agent试图”全知全能”

- 关键成功因素:任务拆解质量、通信设计、结果整合策略

- 学术基础:建立在Multi-Agent Systems几十年研究基础之上

未来展望

Agent Teams还在快速演进中:

- 更智能的Orchestrator:能够动态调整任务分配策略

- 更高效的通信:减少Agent间的信息冗余

- 更好的可观测性:让开发者能清晰看到每个Agent的工作状态

- 标准化协议:不同框架之间的Agent能够互相协作

正如软件工程从”个人英雄主义”发展到”团队协作”一样,AI辅助编程也正在经历同样的转变。Agent Teams代表着这个转变的开始。

参考资源

论文

- AutoGen: Enabling Next-Gen LLM Applications via Multi-Agent Conversation - Microsoft Research

- MetaGPT: Meta Programming for Multi-Agent Collaborative Framework - DeepWisdom et al.

- ChatDev: Communicative Agents for Software Development - Tsinghua University

- A Survey on Large Language Model based Autonomous Agents - 2024 Survey